机器学习笔记-吴恩达的机器学习课(第一周)

在Coursera上注册了吴恩达的机器学习课,可是Coursera上播放视频一直有问题,也就没有上了,今天通过修改hosts,发现可以正常使用了,就想法尽量把位下的课补上。

监督学习和非监督学习:主要在于数据是否已经标明了结果。

回归和分类,本质上类似,区别在于分类的产出是定性的,回归是定量的。

代价函数:与真实值的误差函数。可看这两篇文章:1.博客园文章,2.知乎文章

机器学习对于输入的一系列离散点,找一个函数拟合,比如是线性函数吧,而代价函数则是找的这个线性函数的参数的函数。假如对于一系列值,我们用f(x)=a+bx来表示,那么,代价函数就是关于a和b的函数f(a,b),而我们的目标就是让这个f(a,b)的值最小,如果它的值为0,就相当于完全拟合了。

轮廓图:理解为等高线。

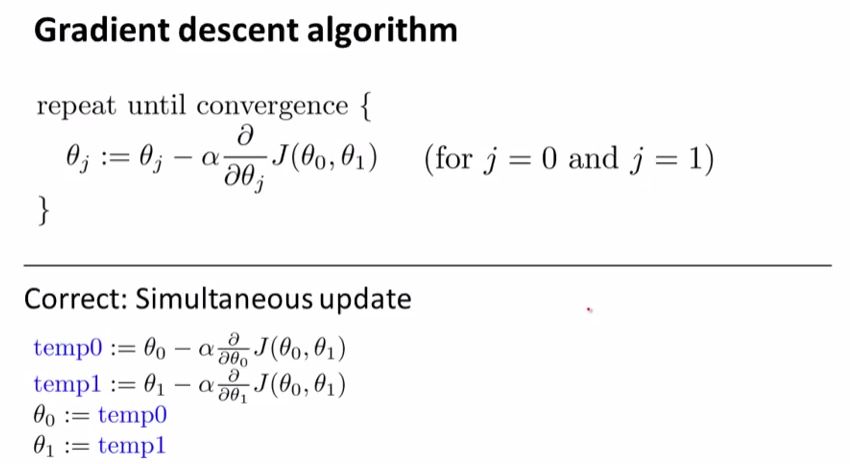

梯度下降算法:对于f(a,b),先定义一个初始的a和b,然后重复地以改变这两个值,使得f(a,b)达到局部最小值,这里涉及两个问题,一个是初始值,不同的初始值选择会得到不同的局部最小值,二是,如何改变这两个值。

上图中,α表示学习速率,也就是变化的幅度。

另外,这个算法中,必须同时变化a,b,而不能在得到temp0时就先更新a。

待扩展学习内容:

octave

方差、均方差等统计学知识

微积分知识